大家好,我是何三,独立开发者

又一款"看图写代码"的模型?

2026年4月2日,智谱发布了 GLM-5V-Turbo。

"又一个多模态模型"——你大概率会这么想。毕竟 GPT-4o 能看图、Gemini 能看视频、Claude 能操作电脑,视觉理解这块赛道已经很拥挤了。

但这次不太一样。

GLM-5V-Turbo 不是那种"什么都能看、什么都能聊"的多模态大杂烩。它的定位非常明确:多模态 Coding 基座模型——说白了,就是专门为了让 AI 能"看设计稿、写代码"而生的。

更直白点:你丢一张 UI 设计稿给它,它能直接吐出一套完整可运行的前端工程。

为什么这件事值得聊?

AI 辅助编程这件事,过去一年半已经被 Claude Code、Cursor、Copilot 们卷得差不多了。但有个痛点一直没解决好:AI 编程基本只能处理文本。

设计师给你一张 Figma 设计稿,你得先人工拆解布局、手写 HTML/CSS 结构,再让 AI 帮你补逻辑。或者录一段操作视频,还得自己描述每一步在干什么。

这个"从视觉到代码"的断层,一直是 AI 编程工具链里最别扭的一环。

GLM-5V-Turbo 试图直接跨过这个断层。

它的输入不只是文字,还可以是图片、视频、设计稿、文档。你录一段手机 App 操作的视频扔给它,它能理解每个页面的布局和交互逻辑,然后直接生成代码复刻出来。

这不是简单的 OCR + 代码生成。智谱从预训练阶段就深度融合了视觉和文本能力,用的是自研的新一代 CogViT 视觉编码器,配合推理友好的 MTP(Multi-Token Prediction)结构。

翻译成人话就是:它不是"看图说话"的模型后面挂了个代码生成器,而是从底层的神经网络上就把"看"和"写"当成一件事来训练的。

数据说话:到底强在哪?

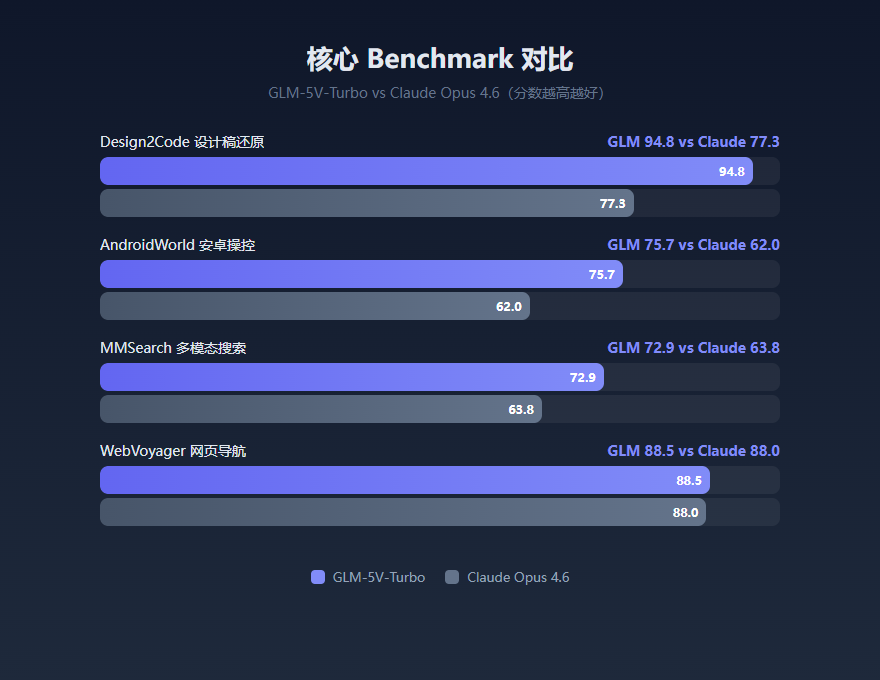

光说概念没意义,直接看 benchmark。

多模态 Coding 场景:

- Design2Code(设计稿还原):94.8 分,Claude Opus 4.6 是 77.3 分

- Flame-VLM-Code(视觉代码生成):93.8 分

- MMSearch(多模态搜索):72.9 分,Claude Opus 4.6 是 63.8 分

GUI Agent 场景:

- AndroidWorld(安卓操控):75.7 分,Claude Opus 4.6 是 62.0 分

- WebVoyager(网页导航):88.5 分,Claude Opus 4.6 是 88.0 分

在视觉编程相关的测试上,GLM-5V-Turbo 基本是碾压状态。Design2Code 94.8 分这个数字尤其亮眼——意味着给一张设计稿,它还原出来的前端页面质量已经非常高了。

当然,纯文本编程方面 Claude Opus 4.6 依然有优势,比如后端代码(CC-Backend 26.9 vs 22.8)和前端代码(CC-Frontend 75.9 vs 68.4)。这也在意料之中——Claude 在纯文本编程上积累太深了。

但 GLM-5V-Turbo 的思路是对的:先把视觉编程这件事做到极致,纯文本能力不退化就行。从 CC-Bench-V2 的结果来看,它的纯文本编程能力确实保持了稳定,没有因为加了视觉能力而变弱。

这背后是智谱做的30+ 任务协同强化学习——同时优化 STEM、grounding、video、GUI Agent、coding Agent 等多个任务类型,避免"学会了看图就忘了写代码"的偏科问题。

跟 Claude Code 怎么配合?

这是比较有意思的部分。

GLM-5V-Turbo 不是来替代 Claude Code 的,而是给它装上"眼睛"。

智谱把这个能力深度适配到了 Claude Code 和自家的 OpenClaw(龙虾)框架里。工作流大致是这样的:

看懂环境 → 规划动作 → 执行任务

比如你想复刻一个网站。过去用 Claude Code,你得人工截图、描述每个页面的结构。现在 GLM-5V-Turbo 可以自己浏览目标网站,梳理页面跳转关系,采集视觉素材和交互细节,然后直接生成代码把整个站点复刻出来。

更实际的场景是代码调试。Bug 页面截个图扔给模型,它能自动识别样式错位、组件重叠、颜色偏差这些渲染异常,辅助定位问题并生成修复代码。

"为龙虾安上眼睛"

如果你关注智谱的生态,一定听过"龙虾"——OpenClaw / AutoClaw,智谱的 Agent 平台。

GLM-5V-Turbo 接入龙虾之后,变化挺大的。龙虾原来只能处理文本任务,现在能看懂屏幕上的信息了。

智谱举了个例子:AutoClaw 上线的"股票分析师" Skill,利用 GLM-5V-Turbo 的视觉能力,龙虾能直接看懂 K 线走势、估值区间图和券商研报图表,四路数据源 60 秒并行采集,输出图文交错的分析报告。

还有文档写作:丢一份 PDF 进去,模型能理解内容并生成小红书风格的宣传文案、报告摘要等。官方演示里甚至展示了视频对象追踪——输入一段骑马的短视频,模型能逐帧输出小马的位置坐标 JSON。

这些场景以前需要多个专用模型串起来才能做,现在一个模型搞定了。

怎么用?

目前 GLM-5V-Turbo 面向 Coding Plan 用户开放,后续会正式纳入 GLM Coding Plan。

有几种使用方式:

1. API 调用

通过智谱 BigModel 开放平台接入,模型名是 glm-5v-turbo,支持图片、视频、文件等多模态输入。上下文窗口 200K tokens,最大输出 128K tokens。

from zai import ZhipuAiClient

client = ZhipuAiClient(api_key="your-api-key")

response = client.chat.completions.create(

model="glm-5v-turbo",

messages=[

{

"role": "user",

"content": [

{

"type": "image_url",

"image_url": {

"url": "https://example.com/design-mockup.png"

}

},

{

"type": "text",

"text": "请根据这张设计稿,生成完整的移动端前端页面代码"

}

]

}

],

thinking={"type": "enabled"}

)

print(response.choices[0].message)

注意输入是多模态的 content 数组,同时包含 image_url 和 text 两种类型。视频输入用 video_url 类型,文件输入用 file_url 类型。

2. AutoClaw(澳龙)

如果你已经在用智谱的龙虾平台,切换到 GLM-5V-Turbo 模型就能直接体验视觉增强能力。

3. Claude Code 集成

支持与 Claude Code 框架深度协同,在 Agent 工作流中调用 GLM-5V-Turbo 的视觉能力。

有哪些局限?

说几个比较现实的问题。

参数量未公开。 智谱这次没有公布 GLM-5V-Turbo 的具体参数规模。从定位"Turbo"来看,大概率比 GLM-5(744B 总参、40B 激活)小不少。但具体小多少,不知道。

暂未开源。 GLM-5 系列虽然号称"开源",但 GLM-5V-Turbo 目前只能通过 API 使用,权重没有放出来。

不能同时处理多种模态输入。 官方明确说了:不支持同时理解文件、视频和图像。一次只能选一种(或图片+文本、视频+文本的组合)。

纯文本编程不是它的主战场。 如果你不涉及视觉相关的编程任务,GLM-5 或 GLM-5-Turbo 的纯文本编码能力可能更合适。

我的看法

GLM-5V-Turbo 让我比较在意的,不是它某个 benchmark 跑了多少分,而是智谱选的这个切入点。

视觉编程这个方向,目前还没有谁真正做到"开箱即用"的程度。Claude 的 Computer Use 能操控桌面,但不是为编程设计的。GPT-4o 能看图写代码,但更多是 demo 级别的展示。

智谱从设计稿还原这个具体场景切入,把"看懂画面 → 理解布局 → 生成代码"这条链路做扎实了。这是一个对前端开发者和设计师来说都很实用的能力。

加上与 Claude Code、AutoClaw 的生态打通,它不是孤立的模型,而是嵌入到了现有的 AI 编程工作流里。这个生态策略比特定的技术指标更值得关注。

对独立开发者来说,如果项目里有大量前端页面开发、设计稿还原的工作,GLM-5V-Turbo 值得试试。哪怕不拿来直接写代码,用来做代码审查和 Bug 定位也很有价值。

毕竟,能让 AI 直接"看到"你的代码运行效果,这个能力本身就打开了不少新玩法。

本文使用 MGO 编辑并发布

关注"何三笔记",回复"mgo" 免费下载使用