大家好,我是何三,独立开发者

最近刷 GitHub Trending,一个叫 PraisonAI 的项目引起了我的注意。6400+ Star,MIT 协议,支持 100+ 大模型,还直接被马斯克在推特上点名引用。

这东西说白了就一件事——让多个 AI Agent 组成团队,替你干活。而且门槛极低,几行代码就能跑起来。

今天花点时间聊聊这个框架到底能干嘛,适不适合你。

先搞清楚:什么是多智能体?

现在大部分人用 AI,还是"一人一对话"的模式。你问一个问题,它答一个,问完即走。

但现实中的工作不是这样的。写一篇文章,你得先调研、再列大纲、再写内容、最后润色。每一步可能需要不同的"人"来做。

多智能体的思路就是:让多个 AI Agent 各司其职,像真实团队一样协作完成复杂任务。

比如一个研究 Agent 负责搜索和整理信息,一个写作 Agent 负责生成内容,一个审核 Agent 负责检查质量。它们之间还能互相交接、传递上下文。

PraisonAI 就是做这个事的框架。

为什么关注 PraisonAI?

市面上做 Agent 框架的项目不少,CrewAI、AutoGen、LangGraph 都是热门选手。但 PraisonAI 有几个点确实比较突出。

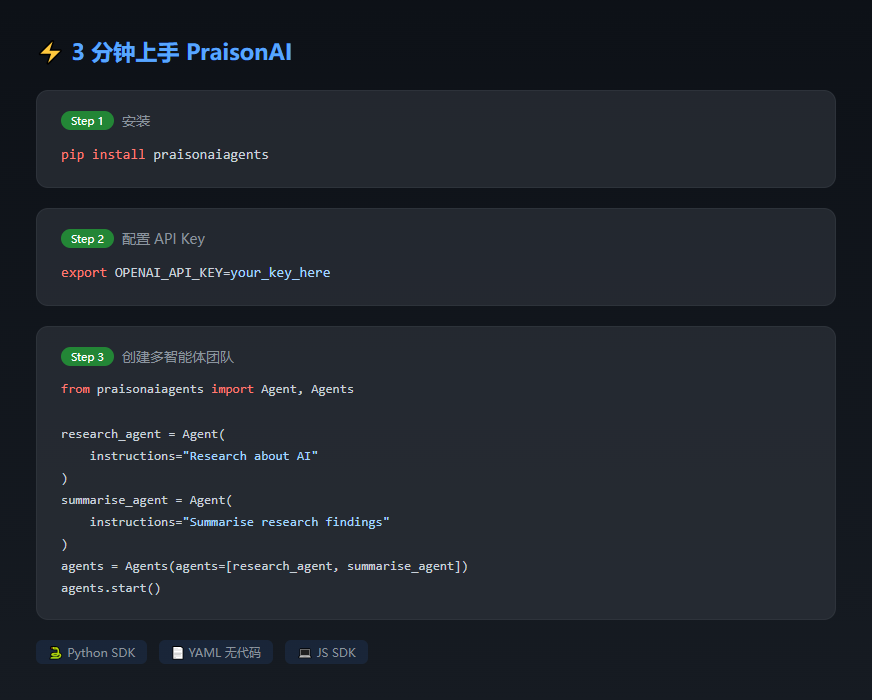

1. 真的低代码,上手极快

from praisonaiagents import Agent, Agents

research_agent = Agent(instructions="Research about AI")

summarise_agent = Agent(instructions="Summarise research findings")

agents = Agents(agents=[research_agent, summarise_agent])

agents.start()

三行代码,两个 Agent 开始协作。这比大多数框架都简洁。不需要复杂的配置,不需要理解一堆抽象概念。

2. 性能怪兽级别

官方数据显示,Agent 实例化平均耗时 3.77 微秒。

什么概念?1 毫秒 = 1000 微秒。这意味着你可以在极短时间内创建大量 Agent 实例,大规模部署也不会有明显的启动开销。

3. 100+ 大模型随便换

OpenAI、Claude、Gemini、DeepSeek、Grok、Ollama 本地模型……一口气支持了 100 多家。切换模型就改个参数的事,不用重写逻辑。

# 用 DeepSeek

agent = Agent(instructions="...", model="deepseek/deepseek-chat")

# 用 Ollama 本地跑

agent = Agent(instructions="...", model="ollama/llama3")

# 用 Grok

agent = Agent(instructions="...", model="xai/grok-beta")

这个灵活性对想省钱或者有合规要求的团队来说,相当实用。

4. 马斯克都点过赞

Elon Musk 在推特上转发了 PraisonAI 的 Grok 3 客户支持教程。虽然不能代表什么技术评价,但至少说明这个项目在社区里已经有一定知名度了。

能力全景图

看了上面的架构图,你会发现 PraisonAI 的野心不止于"多 Agent 协作"。它实际上想做一个完整的 AI 应用开发平台。

几个我觉得比较有意思的能力:

MCP 协议支持

MCP(Model Context Protocol)是最近很火的标准,可以让 Agent 连接各种外部工具和数据源。PraisonAI 支持 stdio、HTTP、WebSocket、SSE 四种传输方式。

from praisonaiagents import Agent, MCP

# 连接本地 MCP 服务器

agent = Agent(tools=MCP("npx @modelcontextprotocol/server-memory"))

# 连接远程 MCP 服务器

agent = Agent(tools=MCP("https://api.example.com/mcp"))

这意味着你可以直接让 Agent 操作数据库、调 API、控制浏览器,而不需要自己造轮子。

AgentFlow 工作流引擎

复杂任务不是简单的"串行执行"就行的。有时候需要并行处理,有时候需要根据中间结果做路由判断。

PraisonAI 的 AgentFlow 提供了 route、parallel、loop、repeat、条件分支、检查点回滚等工作流模式。

打个比方:你要分析 100 个网页,可以用 parallel() 让多个 Agent 同时处理,速度直接翻倍。某一步失败了,还能自动回滚到上一个检查点重试。

记忆和知识库

Agent 可以有短期记忆和长期记忆,还能对接 RAG(检索增强生成)做知识问答。支持 PDF、DOCX 等文档导入,可以对接各种向量数据库。

这就意味着你的 Agent 可以"记住"之前聊过什么,还能基于你提供的文档来回答问题。

直接对接聊天平台

这可能是对普通人最实用的功能——装个 Claw 扩展,就能把 AI Agent 接入 Telegram、Discord、WhatsApp、Slack。

pip install "praisonai[claw]"

praisonai claw

打开 localhost:8082,可视化管理面板就出来了。你的 AI 团队 24/7 在线,用户通过聊天软件直接跟你的 Agent 交互。

客户支持、自动问答、内容推送,这些场景想想就觉得有意思。

实战:搭建一个自动化研究团队

来看一个具体的例子——搭建一个"自动调研 + 写作"的 AI 团队。

用 YAML 方式(完全不需要写代码),创建一个 agents.yaml 文件:

framework: praisonai

topic: "写一篇关于AI Agent框架的技术分析"

agents:

researcher:

role: Research Analyst

goal: 调研 AI Agent 领域最新趋势和技术方案

instructions: "搜索并整理 AI Agent 框架的最新发展,包括技术对比、应用场景"

tools:

- web_search

writer:

role: Content Writer

goal: 基于研究结果撰写技术分析文章

instructions: "用通俗易懂的语言写一篇结构清晰的技术分析文章"

reviewer:

role: Quality Reviewer

goal: 审核文章质量并提出修改建议

instructions: "检查文章的准确性、完整性和可读性"

然后一行命令:

praisonai agents.yaml

三个 Agent 就开始按顺序协作:先调研,再写作,最后审核。每个 Agent 的输出会自动传递给下一个。

如果你想用 Python,灵活性更高:

from praisonaiagents import Agent, Agents

# 创建研究 Agent,开启网页搜索

researcher = Agent(

name="Researcher",

instructions="深度调研AI Agent框架的技术方案",

web_search=True

)

# 创建写作 Agent

writer = Agent(

name="Writer",

instructions="基于研究结果撰写技术文章",

memory=True # 开启记忆

)

# 组建团队

team = Agents(agents=[researcher, writer])

team.start("分析 PraisonAI、CrewAI、AutoGen 三个框架的优劣势")

整个过程大概几分钟就能跑完,产出的质量……说实话,取决于你的 Prompt 写得好不好。但框架本身的编排能力是够用的。

跟其他框架比,优势在哪?

简单对比一下几个主流 Agent 框架:

| 维度 | PraisonAI | CrewAI | AutoGen | LangGraph |

|---|---|---|---|---|

| 上手难度 | ⭐ 极低 | ⭐⭐ 低 | ⭐⭐⭐ 中 | ⭐⭐⭐⭐ 高 |

| 多Agent协作 | ✅ | ✅ | ✅ | ✅ |

| MCP协议 | ✅ | ❌ | ❌ | 插件 |

| 聊天平台集成 | ✅ 内置 | ❌ | ❌ | ❌ |

| 可视化UI | ✅ Claw | ❌ | ❌ | ✅ LangSmith |

| 模型支持 | 100+ | 10+ | 10+ | 10+ |

| 工作流引擎 | ✅ AgentFlow | 简单 | 简单 | ✅ 图引擎 |

| 社区活跃度 | 高 | 高 | 中 | 高 |

PraisonAI 的核心优势在于低门槛 + 全功能。它把很多在别的框架里需要自己拼装的东西,直接内置了。

当然,如果你需要非常精细的图状态管理和复杂的状态机,LangGraph 可能更合适。但说实话,80% 的场景用不到那么复杂的控制。

谁适合用这个?

- 独立开发者:想快速搭建 AI 应用,不想花大量时间在框架选型和底层实现上

- 内容创作者:自动调研、写作、审核流水线

- 创业团队:快速做 AI 原型,验证商业模式

- 技术爱好者:学习 Agent 框架的最佳入门选择之一

一些真实的想法

PraisonAI 虽然功能很全,但也要说几个我观察到的点:

功能太多,文档维护是个挑战。README 里列了 25+ 个特性,对新手来说可能反而会有选择困难。

Star 增长很快(6400+),但跟 CrewAI 的 40k+、LangChain 的 100k+ 比还有距离。生态成熟度还需要时间验证。

不过作为 MIT 协议的开源项目,拿来学习和做原型是完全没问题的。真正适合做生产环境,还需要你根据自己的场景做更多的压力测试和稳定性验证。

项目地址:https://github.com/MervinPraison/PraisonAI 文档:https://docs.praison.ai

感兴趣的可以 clone 下来玩玩,pip install praisonaiagents 一行命令就能开始。

本文使用 MGO 编辑并发布

关注"何三笔记",回复"mgo" 免费下载使用