大家好,我是何三,独立开发者

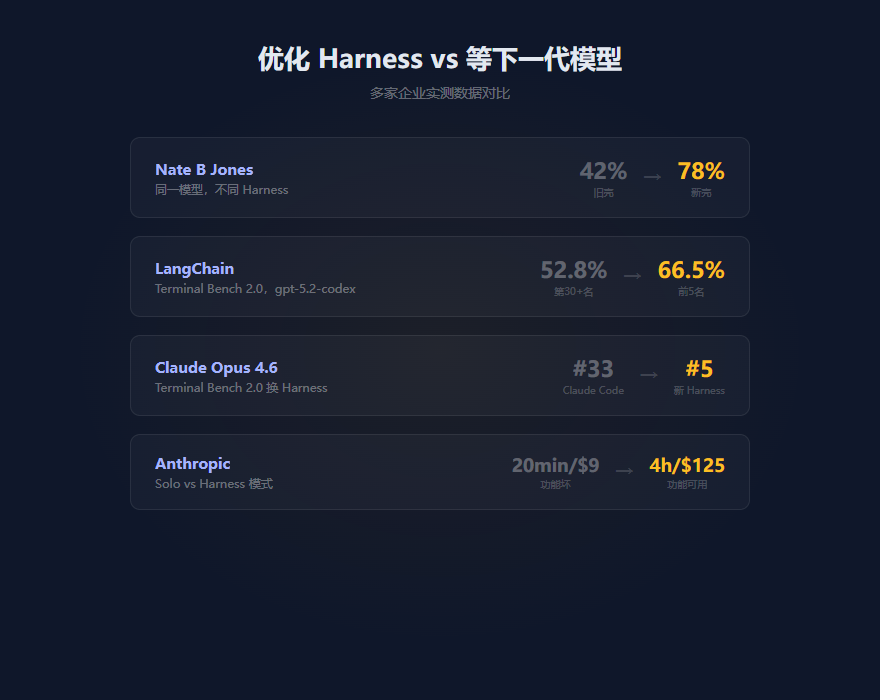

同一个模型,什么都没换。数据没换,提示词没换,只换了模型外面包的那层运行环境,编程基准的成功率从 42% 跳到了 78%。

变量只有一个:模型外面的壳。

Anthropic 前阵子发了篇工程博客:同一句提示词、同一个模型,跑 20 分钟花 9 美元,出来的东西核心功能是坏的;换一套运行方式,跑 4 小时花 125 美元,出来一个能玩的游戏。

这层壳,现在有个正式名字:Harness。围绕它展开的工程实践,叫 Harness Engineering。

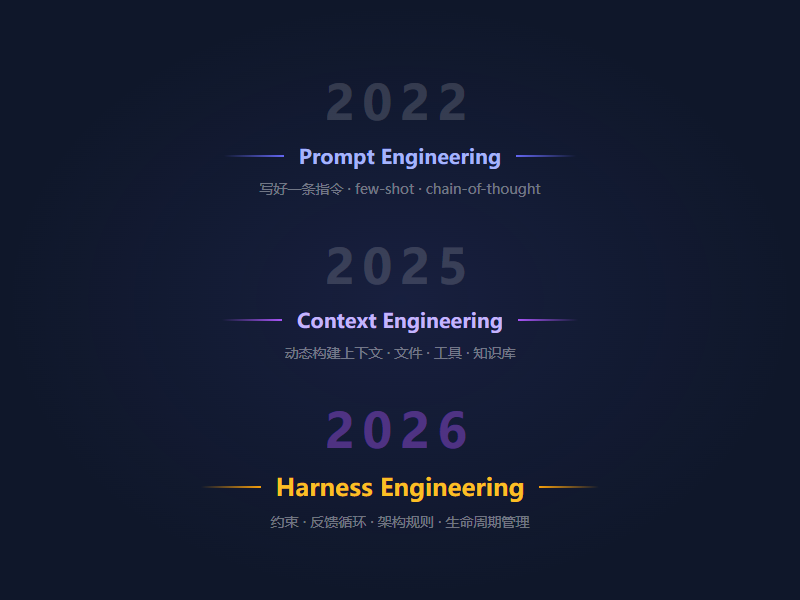

三代进化

理解 Harness 之前,先快速过一遍它的前两代。

2022-2024,Prompt Engineering——琢磨怎么写好一条指令。2025,Context Engineering——Karpathy 和 Shopify CEO Tobi Lütke 推动,关注怎么为模型动态构建完整上下文。

2026 年 2 月,Harness Engineering 来了。

打个比方:Prompt Engineering 是写好一封邮件。Context Engineering 是把相关附件带上。Harness Engineering,是搭整个工作环境——约束、反馈循环、架构规则、工具链、生命周期管理。

这个词最早来自 Mitchell Hashimoto——HashiCorp 联合创始人、Terraform 缔造者。定义就一句话:

每当你发现 Agent 犯了一个错误,你就花时间去工程化一个解决方案,让它再也不会犯同样的错。

几天后 OpenAI 跟进重磅博文,Martin Fowler 团队接着分析,几周内这个词火遍 AI 工程圈。

Agent 不难,Harness 才难

OpenAI Codex 团队做了个实验:空仓库起步,5 个月,100 万行代码,1500 个 PR,人类一行代码都没写。7 个工程师,平均每人每天合并 3.5 个 PR。传统手写,工期大概是 10 倍。

核心工程师 Ryan Lopopolo 写了句话:Agent 不难,Harness 才难。 他们总结了几条硬规则:仓库是 Agent 唯一的知识来源;架构约束不靠 prompt,靠 linter;如果 PR 需要大改才能合并,问题不在 Agent,在 Harness。

Stripe 的内部系统每周合并 1300+ 个无人值守 Agent PR,CI 最多跑两轮——不允许无限重试。他们挂了约 500 个 MCP 工具,但给每个 Agent 只给精心筛选的子集。

Cursor 的实验更极端——每小时约 1000 个 commit,一周超 1000 万次工具调用。他们迭代了五版架构才找到相对稳定的方案,发现一个黑色幽默:一条模糊指令在数百个并发 Agent 之间会被放大,一个错乘以几百个,后果灾难性。

Stripe 工程团队的总结很直白:成功取决于可靠的开发者环境、测试基础设施和反馈循环,跟模型选择关系不大。

模型不会反省

这些案例都在解决一个问题:怎么让 Agent 稳定产出高质量代码。但 Anthropic 的博客拆出了一个更底层的问题。

模型不会评价自己的工作。 让 Agent 自评,它会自信表示写得很好。即使人类看来质量明显不行。主观任务尤其严重——前端设计好不好看,没有二元标准。

Anthropic 的解法借鉴了 GAN 的思路:把生成和评估拆成两个独立 Agent。

generator 负责写,evaluator 负责评。evaluator 用 Playwright 真的去点页面、查 API、看数据库状态,像真人 QA 一样操作完再给反馈。

但开箱即用的 Claude 是个很差的 QA Agent。早期的 evaluator 会发现问题,然后说服自己这不是大问题,接着批准了。Anthropic 花了好几轮校准 evaluator 的严苛程度。

关键发现:让独立 evaluator 变严格,远比让 generator 学会自我批评容易得多。 这就是拆分的价值。

数据不会说谎

- Nate B Jones:同一模型,不同 Harness,成功率 42% vs 78%

- LangChain:只改 Harness,成绩从 52.8% 升到 66.5%,排名从三十开外进前五

- Claude Opus 4.6:换 Harness 后排名从第 33 冲到第 5

- Pi Research:一个下午内仅通过修改 Harness,提升了 15 个不同 LLM 的编程能力

优化模型外面的壳,回报率可能比等下一代模型更高。

当然,反对声音也有。OpenAI 的 Noam Brown 说 Harness 是根拐杖,迟早被淘汰——就像推理模型一出,之前围绕 GPT-4o 搭的复杂 Agentic 系统一夜之间多余了。METR 的数据也显示,自动评分器高估了 Agent 约 7 倍的能力。

但 Anthropic 的实验自己就是反驳。Opus 4.6 比 4.5 更强,sprint 结构直接被砍掉了。可 evaluator 没有被砍。 模型能力边界只是往外推了一些,边界本身没消失。他们判断:harness 的可能性空间不会缩小,只会平移。

写在最后

OpenAI 团队不写代码了,写架构规则。Stripe 工程师不写代码了,写编排策略。Anthropic 工程师不写代码了,写 evaluator 的校准逻辑。

写代码正在变便宜。设计那套让 Agent 持续稳定写代码的系统,才是真正贵的部分。 而且每隔几个月,模型升级,这层壳就得重新审视。

真正稀缺的能力,不在模型里面,在模型外面。

本文使用 MGO 编辑并发布

关注"何三笔记",回复"mgo" 免费下载使用