大家好,我是何三,独立开发者

最近很多朋友问我:"何三,我们公司想用AI大模型,但是担心数据安全问题,有没有什么好的解决方案?"

确实,随着ChatGPT、DeepSeek等大模型的火爆,越来越多的企业想要在业务中引入AI能力。但是,直接使用公有云服务存在几个痛点:

数据安全风险:企业的核心数据要上传到第三方服务器,这对于金融、医疗、法律等对数据安全要求极高的行业来说,简直是不可接受的。

成本问题:按token计费,用多了钱包受不了。而且高峰期还可能遇到限流。

网络依赖:需要联网才能使用,内网环境完全用不了。

今天给大家推荐一个神器——DeepSeek一键私有化部署工具,让你5分钟就能让企业拥有自己的AI大模型,数据完全不出内网!

这个工具是什么?

简单来说,它就是一个开箱即用的DeepSeek私有化部署方案。你不需要懂Docker,不需要懂模型部署,只需要一条命令,就能在你的服务器上跑起来一个完整的AI大模型服务。

它最大的特点就是简单,就像安装一个普通软件一样简单。

核心特性

这个工具提供了很多贴心的功能,我来给大家重点介绍几个:

一键安装,自动检测环境 它会自动检测你的服务器环境(GPU/CPU/内存),然后选择最合适的部署方式。不管你是只有CPU的服务器,还是有高端GPU的机器,都能跑起来。

自带Web聊天界面 安装完成后,直接访问 http://localhost:3000 就能开始聊天,界面简洁易用,就像用ChatGPT一样。

完全私有化,数据不出服务器 所有数据都在你自己的服务器上处理,完全不用担心数据泄露。这对于企业来说太重要了。

兼容OpenAI API格式 这个功能太实用了!它完全兼容OpenAI的API格式,意味着你现有的应用只需要改一个base_url就能无缝对接,不需要重写代码。

支持多种模型 从1.5B到70B,从轻量级到旗舰级,你可以根据服务器配置选择合适的模型。

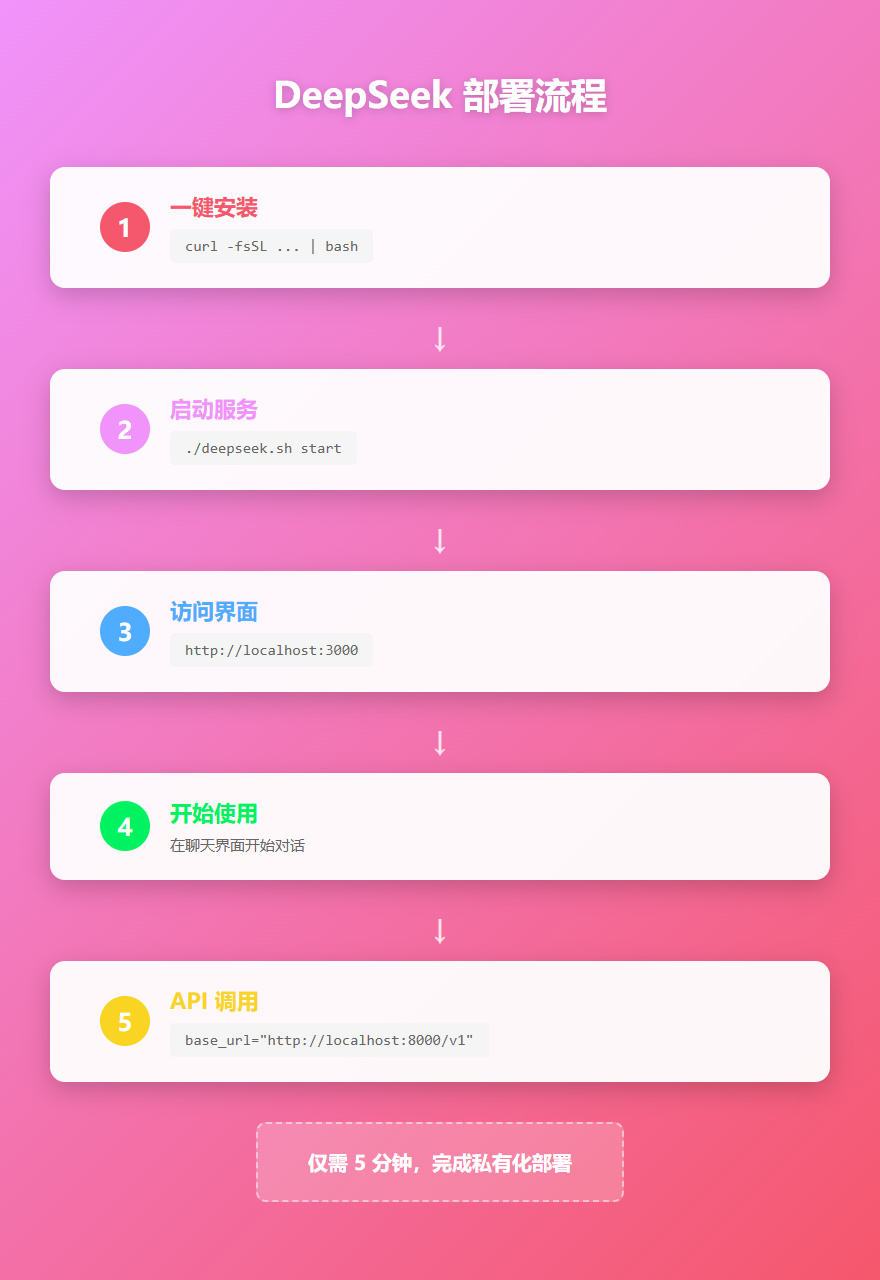

快速上手

说了这么多,怎么用呢?超级简单!

一键安装

只需要一条命令:

curl -fsSL https://raw.githubusercontent.com/LingLin6/deepseek-deploy/main/install.sh | bash

这个命令会自动下载安装脚本并执行,整个过程大概需要5-10分钟(取决于你的网络速度)。

启动服务

安装完成后,使用以下命令启动服务:

./deepseek.sh start

启动后,你就可以通过浏览器访问 http://localhost:3000 开始使用了!

常用管理命令

# 停止服务

./deepseek.sh stop

# 查看状态

./deepseek.sh status

# 切换模型

./deepseek.sh model deepseek-r1-14b

# 查看日志

./deepseek.sh logs

代码实战:调用API

既然兼容OpenAI API格式,那我们就可以用熟悉的OpenAI Python SDK来调用。来看个例子:

from openai import OpenAI

# 创建客户端,只需要改base_url

client = OpenAI(

base_url="http://localhost:8000/v1",

api_key="not-needed" # 本地部署不需要真实的key

)

# 发送请求

response = client.chat.completions.create(

model="deepseek-r1",

messages=[

{"role": "user", "content": "你好,请介绍一下Python"}

]

)

# 获取回复

print(response.choices[0].message.content)

就这么简单!你原本用OpenAI API的代码,只需要改一下base_url就能用本地部署的DeepSeek了。

系统要求

在部署之前,先看看你的服务器是否满足要求:

操作系统:Ubuntu 20.04+ / CentOS 7+ / Windows WSL2

内存:最低8GB(推荐16GB+)

硬盘:最低20GB可用空间

GPU(可选):NVIDIA GPU + CUDA 11.8+(有GPU会快很多)

网络:安装时需要联网,运行时可离线

模型选择建议

根据不同的使用场景,选择合适的模型:

| 模型 | 参数量 | 最低显存 | 推荐场景 |

|---|---|---|---|

| DeepSeek-R1-1.5B | 1.5B | 2GB | 轻量对话、测试 |

| DeepSeek-R1-7B | 7B | 6GB | 日常办公、客服 |

| DeepSeek-R1-14B | 14B | 12GB | 专业写作、编程 |

| DeepSeek-R1-32B | 32B | 24GB | 企业级应用 |

| DeepSeek-R1-70B | 70B | 48GB | 高端推理 |

| DeepSeek-V3 | 671B | 多卡/集群 | 旗舰级 |

小贴士:如果只是用来做简单的对话和文本处理,7B或14B模型就够用了。如果需要更复杂的推理任务,再考虑更大的模型。

架构原理

这个工具的架构设计很清晰,分为四层:

Web聊天界面:提供友好的用户交互界面

API网关:兼容OpenAI API格式,方便现有应用接入

Ollama推理引擎:负责模型的加载和推理

DeepSeek模型:存储在本地,完全私有化

实际应用场景

这个工具在实际工作中有很多应用场景:

智能客服系统 企业可以搭建自己的智能客服,处理常见问题,减轻人工客服压力。

内部知识库问答 结合RAG技术,可以让AI基于企业内部文档回答问题,提高工作效率。

代码辅助 开发团队可以用它来辅助编程,提高开发效率。

文档生成 自动生成各种文档、报告、邮件等,节省时间。

总结

今天给大家介绍的DeepSeek一键私有化部署工具,最大的优势就是:

✅ 简单易用:一条命令完成部署,不需要专业知识

✅ 数据安全:完全私有化,数据不出内网

✅ 成本可控:一次性部署,无限次使用

✅ 无缝集成:兼容OpenAI API,现有应用轻松接入

✅ 灵活配置:支持多种模型,适应不同需求

如果你正在为企业寻找AI大模型的私有化部署方案,这个工具绝对值得一试!

最后提醒:部署前请确保服务器满足最低要求,建议先用小模型测试,确认没问题后再切换到大模型。

有什么问题欢迎在评论区交流,我是何三,我们下期再见!