大家好,我是何三,独立开发者

今天要给大家分享一个重磅技术——微软开源的 BitNet,这是一个能让大语言模型在本地设备上高效运行的推理框架。

为什么需要 BitNet?

随着大语言模型的发展,我们面临着两个核心挑战:

算力成本高:运行一个 7B 参数的模型,通常需要昂贵的 GPU,动辄几万甚至几十万的硬件成本。

能耗巨大:大模型推理需要消耗大量电力,不利于环保,也增加了运营成本。

而 BitNet 的出现,正是为了解决这些问题。它通过1.58-bit 量化技术,将模型的参数压缩到极致,同时保持模型性能几乎无损。

BitNet 的核心原理

什么是 1.58-bit 量化?

传统的深度学习模型通常使用 16-bit 或 32-bit 浮点数来存储参数,而 BitNet 将每个参数压缩到只有 1.58-bit。

这里的"1.58-bit"是什么意思呢?简单来说,每个参数只有三个可能的值:-1、0、+1。这种表示方式被称为三元量化。

为什么三元量化有效?

虽然听起来很不可思议,但研究表明,大语言模型的参数中,很多都是冗余的。通过三元量化,我们可以:

- 大幅减少存储空间:从 16-bit 到 1.58-bit,存储需求降低约 10 倍

- 加速计算:三元运算比浮点运算快得多

- 降低能耗:更少的内存访问和计算操作

BitNet 的惊人性能

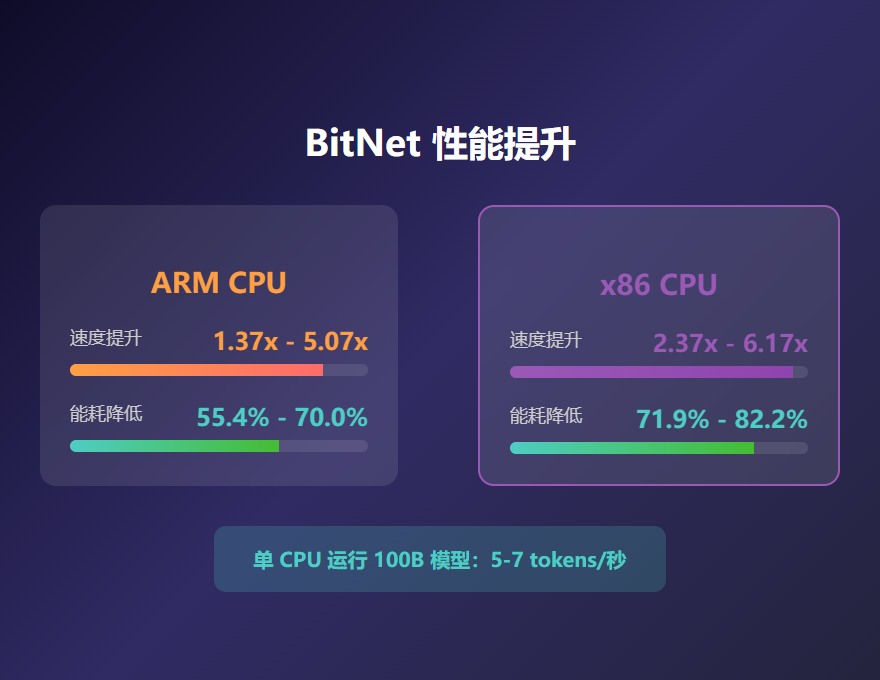

根据微软的官方数据,bitnet.cpp 在不同硬件平台上的表现令人印象深刻:

ARM CPU 性能

- 速度提升:1.37x 到 5.07x

- 能耗降低:55.4% 到 70.0%

x86 CPU 性能

- 速度提升:2.37x 到 6.17x

- 能耗降低:71.9% 到 82.2%

最令人兴奋的是,bitnet.cpp 可以在单个 CPU上运行 100B 参数的 BitNet b1.58 模型,速度达到 5-7 tokens/秒,相当于人类阅读的速度!

这意味着什么?你可以在普通的笔记本电脑上,运行一个原本需要服务器集群才能运行的超大模型!

代码实战:安装和使用 BitNet

环境准备

首先,确保你的系统满足以下要求: - Python >= 3.9 - CMake >= 3.22 - Clang >= 18

安装步骤

1. 克隆仓库

git clone --recursive https://github.com/microsoft/BitNet.git

cd BitNet

2. 创建虚拟环境(推荐)

conda create -n bitnet-cpp python=3.9

conda activate bitnet-cpp

3. 安装依赖

pip install -r requirements.txt

4. 下载模型

huggingface-cli download microsoft/BitNet-b1.58-2B-4T-gguf --local-dir models/BitNet-b1.58-2B-4T

5. 配置环境

python setup_env.py -md models/BitNet-b1.58-2B-4T -q i2_s

运行推理

配置完成后,你就可以开始使用 BitNet 进行推理了:

# 交互式对话

./main -m models/BitNet-b1.58-2B-4T/ggml-model-i2_s.gguf -p "你好,请介绍一下你自己" -n 256

# 批量处理

./main -m models/BitNet-b1.58-2B-4T/ggml-model-i2_s.gguf -f input.txt -o output.txt

支持的模型

BitNet 目前支持多种 1-bit LLM 模型:

官方模型

- BitNet-b1.58-2B-4T:2.4B 参数,支持 x86 和 ARM CPU

社区模型

- bitnet_b1_58-large:0.7B 参数

- bitnet_b1_58-3B:3.3B 参数

- Llama3-8B-1.58-100B-tokens:8.0B 参数

- Falcon3 系列:1B-10B 参数

- Falcon-E 系列:1B-3B 参数

BitNet 的技术亮点

1. 优化的内核实现

bitnet.cpp 提供了一套优化的内核,支持: - I2_S 内核:整数运算优化 - TL1 内核:查找表方法(ARM 专用) - TL2 内核:高级查找表方法

2. 并行化处理

最新的优化引入了并行内核实现,通过可配置的分块和嵌入量化支持,在不同硬件平台和工作负载上实现了 1.15x 到 2.1x 的额外加速。

3. 跨平台支持

- CPU:x86 和 ARM 架构

- GPU:NVIDIA GPU(官方内核)

- NPU:即将推出

应用场景

BitNet 的出现,为以下场景带来了新的可能:

1. 边缘计算

在手机、平板等移动设备上运行大模型,无需云端连接。

2. 离线应用

在没有网络的环境下,依然可以使用 AI 能力。

3. 隐私保护

数据在本地处理,无需上传到云端,保护用户隐私。

4. 成本降低

大幅降低硬件和能源成本,让更多人能够使用大模型。

总结

BitNet 代表了大语言模型部署的一个重要方向。通过 1.58-bit 量化技术,它实现了:

✅ 性能提升:2-6 倍的推理速度提升 ✅ 能耗降低:55%-82% 的能耗减少 ✅ 成本下降:在普通 CPU 上运行超大模型 ✅ 隐私保护:本地推理,数据不上云

对于开发者来说,BitNet 让我们能够在有限的硬件资源下,部署和运行强大的大语言模型。这对于推动 AI 技术的普及和应用具有重要意义。

如果你对本地部署大模型感兴趣,不妨试试 BitNet,相信你会被它的性能所震撼!