大家好,我是何三,独立开发者

当所有 AI 公司还在拼参数、堆算力的时候,一家叫 PrismML 的初创公司选了个反方向:把模型压缩到只剩 1 比特。

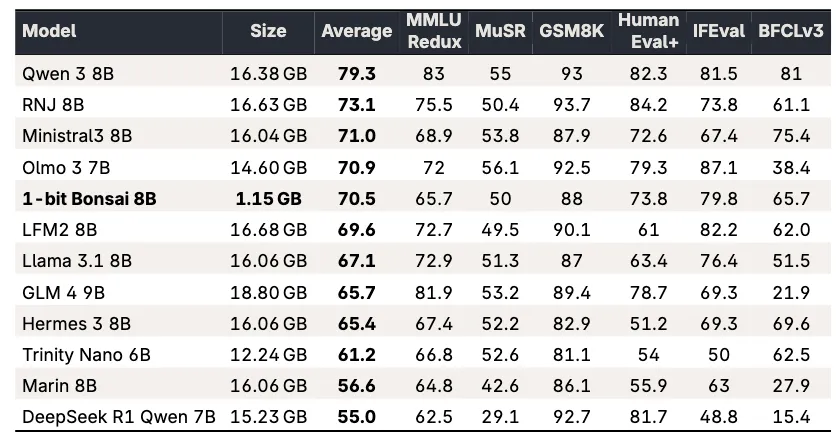

3月31日,他们发布了 1-bit Bonsai 8B 模型。效果怎么说呢——一个 8B 参数的模型,FP16 架构要吃 16GB 内存,Bonsai 8B 只要 1.15GB。推理速度直接翻了 8 倍,功耗砍掉 75%-80%。

更关键的是,这个模型已经跑通了 Mac、iPhone、iPad 和 NVIDIA GPU。

先搞清楚:为什么 1-bit 这么猛?

平时我们说一个大模型"16GB",指的是权重用 FP16 格式存储,每个参数占 16 个比特。1-bit 是什么意思?每个参数只用 1 个比特,要么是 0,要么是 1。

就这么简单粗暴。

但问题来了——精度这么低,模型不就废了吗?这也是 PrismML 花了好几年才啃下来的硬骨头。他们不是简单地把现有模型"量化"成 1-bit,而是从训练阶段就构建了原生的 1 比特架构。

CEO Babak Hassibi 是加州理工教授,他把这项技术描述为一种"数学突破"。具体来说,他们通过特殊的训练方法,让二值化网络在学习过程中保持足够的信息密度。

结果就是:同等参数规模下,性能几乎不降,但资源消耗断崖式下降。

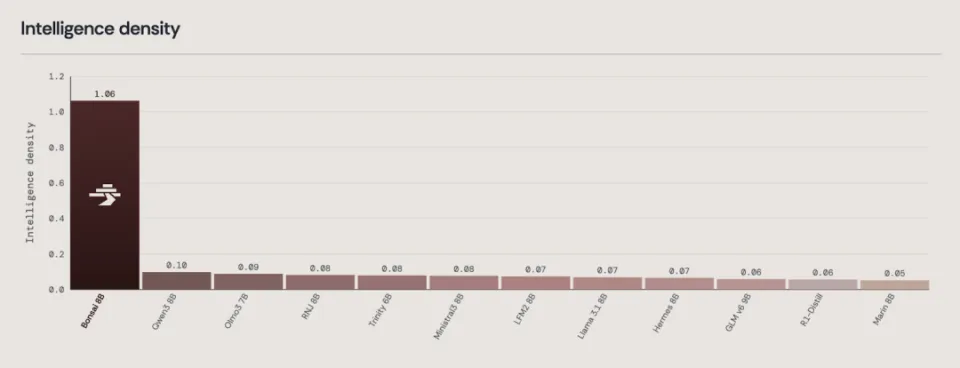

智能密度:衡量模型效率的新指标

PrismML 提了一个概念叫"智能密度"——模型智能 / 模型体积。

按这个标准算,1-bit Bonsai 8B 的智能密度是 1.06/GB。同样 8B 参数的 Qwen3 8B 呢?0.10/GB。

差距差不多是 10 倍。

再看看跑分。在 MMLU-Redux 知识测试、MuSR 多步推理、GSM8K 数学、HumanEval+ 代码生成等 6 个维度上,Bonsai 8B 平均 70.5 分,Qwen3 8B 是 79.3 分。差不到 9 分,但内存占用只有人家的 1/14。

这就是"智能密度"的核心——不是性能最强,而是每 GB 内存能榨出多少智能。

实测数据:iPhone 上每秒 44 token

这才是我觉得最有意思的部分。

他们在不同设备上跑了吞吐量测试:

| 设备 | 吞吐量 |

|---|---|

| RTX 4090 | 440 token/s |

| M4 Pro Mac | 136 token/s |

| iPhone 17 Pro Max | 44 token/s |

iPhone 上每秒 44 token,这个数字意味着什么?日常对话和简单任务完全够用。

最夸张的是一个长周期智能体测试:模拟 50 个工单的汇总和分配任务。同一时间段内,Bonsai 8B 处理完了全部 50 个工单,而标准的 FP16 8B 模型只完成了 6 个。

8 倍的差距,直接体现在工作效率上。

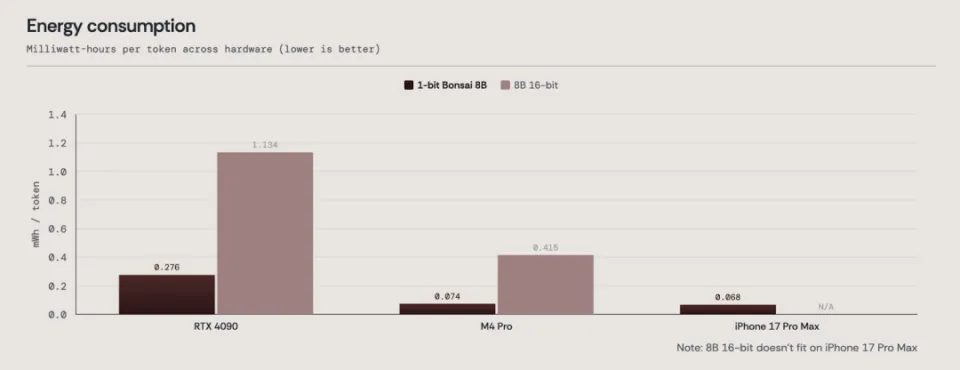

能耗方面,在 iPhone 17 Pro Max 上只有 0.068 毫瓦时/token,M4 Pro 上是 0.074。比 FP16 版本能效提升了 4-5 倍。

为什么这事儿很重要?

PrismML 提到了一个经常被忽略的事实:端侧推理真正的瓶颈不是算力,而是内存带宽。

手机芯片的 NPU 算力其实很强,但模型太大,从内存搬运数据到计算单元这一步就卡死了。1-bit 把内存占用压缩了 14 倍,等于直接把瓶颈给打通了。

这意味着什么?

- 本地 AI 不再是噱头。8B 模型直接跑在手机上,不需要连云端

- 隐私场景终于有解了。医疗、金融这类数据敏感领域,本地推理是刚需

- 机器人、可穿戴设备这些对功耗和体积有极端要求的场景,突然变得可行了

PrismML 还推出了更小的 Bonsai 4B(0.5GB)和 Bonsai 1.7B(0.24GB),专门针对资源更受限的设备。

也有局限

要说完美那肯定是吹的。

PrismML 自己承认,目前的结果还是在通用硬件和软件优化下实现的,移动端的能耗数据也是通过电池耗电速率间接估算的。另外,模型的综合得分和顶级模型还有差距,70.5 分 vs 79.3 分,差的那 9 分在某些场景下可能很关键。

不过他们提到一个很有想象力的方向:如果未来硬件专门为 1-bit 模型做适配,连乘法运算都不需要了,只做加减法,性能和能效还能再提升一个数量级。

当然,这取决于芯片厂商愿不愿意专门为 1-bit 做定制。

写在最后

整个 AI 行业的叙事一直是"更大、更强、更贵"。PrismML 的路线恰好相反——更小、更省、更快。

投资方 Khosla Ventures 创始人 Vinod Khosla 说了一句话我挺认同的:

"人工智能的未来,不取决于谁能建最大的数据中心,而取决于谁能以单位能源和成本提供最大的智能。"

这个方向是不是终局我不确定,但至少它让 AI 从云端走向每个人的口袋,从高不可攀变得触手可及。

参考资料: - PrismML 官方技术报告:https://github.com/PrismML-Eng/Bonsai-demo/blob/main/1-bit-bonsai-8b-whitepaper.pdf - PrismML 官网:https://prismml.com

本文使用 MGO 编辑并发布

关注"何三笔记",回复"mgo" 免费下载使用