大家好,我是何三,独立开发者

即梦悄悄放了个大招——CLI 工具正式开放。

不是那种"网页端加了个按钮"的升级,是真的可以在终端里敲命令生成视频、生成图片,还能让 AI Agent 直接调用。

这事对普通用户感知不大,但对我们这些搞开发的人来讲,意味着 AI 视频生产彻底进入了自动化流程。

我仔细研究了它的文档和命令体系,这篇把安装、命令、实战场景全部给你讲透。

为什么要关注这个 CLI

先说一下背景。

即梦背后是字节跳动的 Seed 实验室,之前推出的 Seedance 2.0 在 AI 视频圈已经炸过一轮了——原生 2K 画质、多镜头叙事、音视频同步生成、8+ 语言唇形同步,这些能力放到国际上也是第一梯队。

但之前你用这些能力,得打开浏览器、登录、填表单、等生成、手动下载。整个流程对单个用户没问题,对 Agent 来说,浏览器操作就是噩梦。

现在 CLI 出来了,所有能力都暴露成了命令行接口。这意味着什么?

Agent 可以直接在代码里调用,不需要模拟点击、不需要 Selenium、不需要任何浏览器自动化方案。一行命令,直接出片。

这是质变。

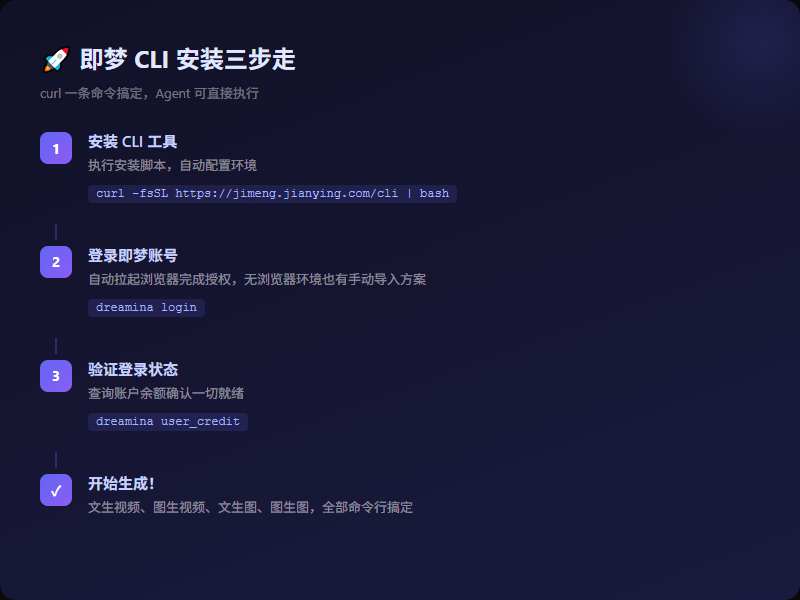

安装:三分钟搞定

即梦 CLI 的安装非常简单,官方推荐的方式是直接用 curl 安装:

curl -fsSL https://jimeng.jianying.com/cli | bash

执行完这条命令,CLI 就装好了。不需要配环境变量,不需要装依赖,开箱即用。

而且官方特别说了一句话:推荐让 AGENT 帮你执行安装。 这态度很明确了——这个工具就是给 Agent 用的。

装完之后,登录你的即梦账号:

dreamina login

这条命令会自动拉起浏览器,引导你完成授权。如果你的机器上没有浏览器(比如服务器环境),它会给出手动导入登录态的方案,跟着指引走就行。

登录完之后,跑一条命令验证一下:

dreamina user_credit

能正常返回余额信息的 JSON,就说明一切就绪,可以开始生成了。

💡 遇到问题?加

--debug参数重试,终端会打印调试信息帮你排查。

核心命令:四大生成能力

即梦 CLI 目前暴露了四个核心能力,覆盖了从图片到视频的完整生成链路。

1. 文生视频(text2video)

最核心的能力。给一段文字描述,生成视频。

dreamina text2video \

--prompt="镜头推进,一只橘猫从沙发上跳下来" \

--duration=5 \

--ratio=16:9 \

--video_resolution=720P \

--poll=30

参数说明:

- --prompt:提示词,描述你想要的画面

- --duration:视频时长(秒)

- --ratio:画面比例,支持 16:9、9:16、1:1 等

- --video_resolution:分辨率,支持 720P 等

- --poll=30:重点参数。表示提交后轮询等待 30 秒,如果在这期间生成完成,直接返回结果。超时则返回一个 submit_id,你后面可以再查

2. 图生视频(image2video)

给一张图片做首帧,生成视频。这个在制作连贯分镜的时候特别有用。

dreamina image2video \

--image ./first_frame.png \

--prompt="镜头慢慢推近" \

--duration=5 \

--poll=30

--image 参数指向本地图片路径。你可以让 Agent 先用文生图生成首帧,再丢给图生视频做成动态——链式生成,全自动。

3. 文生图(text2image)

不只是视频,图片生成也支持。

dreamina text2image \

--prompt="一只戴墨镜的橘猫" \

--ratio=1:1 \

--resolution_type=2k \

--poll=30

直接输出 2K 画质的图片。拿来做视频首帧、做海报素材、做产品原型图都行。

4. 图生图(image2image)

基于参考图做风格迁移或编辑。

dreamina image2image \

--images ./input.png \

--prompt="改成水彩风格" \

--resolution_type=2k \

--poll=30

任务管理:异步 + 轮询

AI 视频生成不是秒出的,通常需要几十秒到几分钟。所以 CLI 的任务管理机制很重要。

两种模式:

同步等待模式——加 --poll 参数,工具会自动轮询状态:

dreamina text2video \

--prompt="..." \

--poll=60

60 秒内完成就直接返回结果,超时就给你一个 submit_id。

异步查询模式——拿到 submit_id 后随时查:

# 查询结果

dreamina query_result --submit_id=<你的_submit_id>

# 查询并直接下载到指定目录

dreamina query_result --submit_id=<你的_submit_id> --download_dir=./downloads

还可以查看所有历史任务:

# 查看所有任务

dreamina list_task

# 只看成功的

dreamina list_task --gen_status=success

# 按 ID 筛选

dreamina list_task --submit_id=<你的_submit_id>

这套机制对 Agent 来说非常友好。Agent 可以提交任务 → 拿到 submit_id → 继续处理其他事 → 回来查结果 → 下载文件。完全不需要阻塞等待。

Agent 集成:这才是杀手锏

CLI 本身是个好工具,但更大的想象空间在 Agent 集成。

你可以给 Agent 一句话需求:

"帮我做一条 30 秒的赛博朋克风格产品宣传片,要有背景音乐和镜头切换。"

Agent 的工作流大概是这样的:

用户需求

↓

Agent 分析需求,拆解为 6 个 5 秒分镜

↓

每个分镜 → dreamina text2image 生成首帧

↓

每个首帧 → dreamina image2video 生成视频片段

↓

dreamina query_result 收集所有结果

↓

合并、配音、导出

↓

完成!

全程零人工干预。Agent 自己写提示词、自己调参数、自己管理任务队列、自己下载和拼接。

这就是即梦官方说的——"即梦 CLI 是一个面向 Agent 的工具包"。

它不是给人类直接用的(虽然也能用),设计目标就是让 Agent 在任意工作流中嵌入即梦的生成能力。批量任务、定时任务、自动化流水线,全部可以搞定。

跟其他方案比

即梦 CLI 最大的差异化在于:它是从设计之初就面向 Agent 的。Sora 和 Runway 也有 API,但你需要自己写 HTTP 请求、处理认证、管理异步回调。即梦 CLI 把这些全封装好了,Agent 直接读文档就能干活。

一些实用建议

折腾了几天,总结几条经验:

1. 提示词要具体。 别写"一个漂亮的女孩",写"一位穿红色连衣裙的年轻女性,漫步在傍晚的樱花林中,黄金时段光线,镜头缓慢推进"。主体 + 动作 + 场景 + 光线 + 镜头,缺一不可。

2. 先生图再生视频。 直接文生视频有时候画面不够稳定。先生成一张高质量首帧,再用 image2video 做动态化,效果会好很多。

3. 用 --poll 别省。 不加 poll 参数,你得自己手动查结果。加了 poll,工具帮你等着,省心。

4. 批量任务注意额度。 每个账号都有生成额度(dreamina user_credit 可查),跑大批量之前先确认余额。

5. 出问题先看 config。 登录态存在 ~/.dreamina_cli/config.toml 里,生成命令报错的话先检查这个文件。

写在最后

AI 视频这个赛道,我觉得 2026 年是一个分水岭。

之前大家还在争论"AI 视频能不能用",现在问题已经变成了"怎么最高效地用"。即梦 CLI 的推出,本质上是在回答后一个问题——把 AI 视频能力嵌入到自动化工作流里。

这对独立开发者和小团队尤其重要。以前做视频内容,要么自己学剪辑,要么花钱外包。现在有了 Agent + CLI,你可以把视频生产变成代码逻辑的一部分。

技术一直在进步,门槛一直在降低。关键是——你的工作流准备好了没有?

本文使用 MGO 编辑并发布

关注"何三笔记",回复"mgo" 免费下载使用